新闻资讯

2026年4月4日

智谱发布开源免费模型GLM-4.7-Flash,为轻量部署提供新选择

智谱公司近日推出开源免费模型GLM-4.7-Flash,这是一个30B-A3B MoE模型,在多项基准测试中表现优异,支持本地部署,适用于编程、中文写作等多种场景。

智谱公司于2026年1月19日发布了开源免费模型GLM-4.7-Flash,这是一个30B-A3B MoE模型(混合专家模型),作为30B级别中最强的模型,为轻量部署提供了平衡性能与效率的新选项。

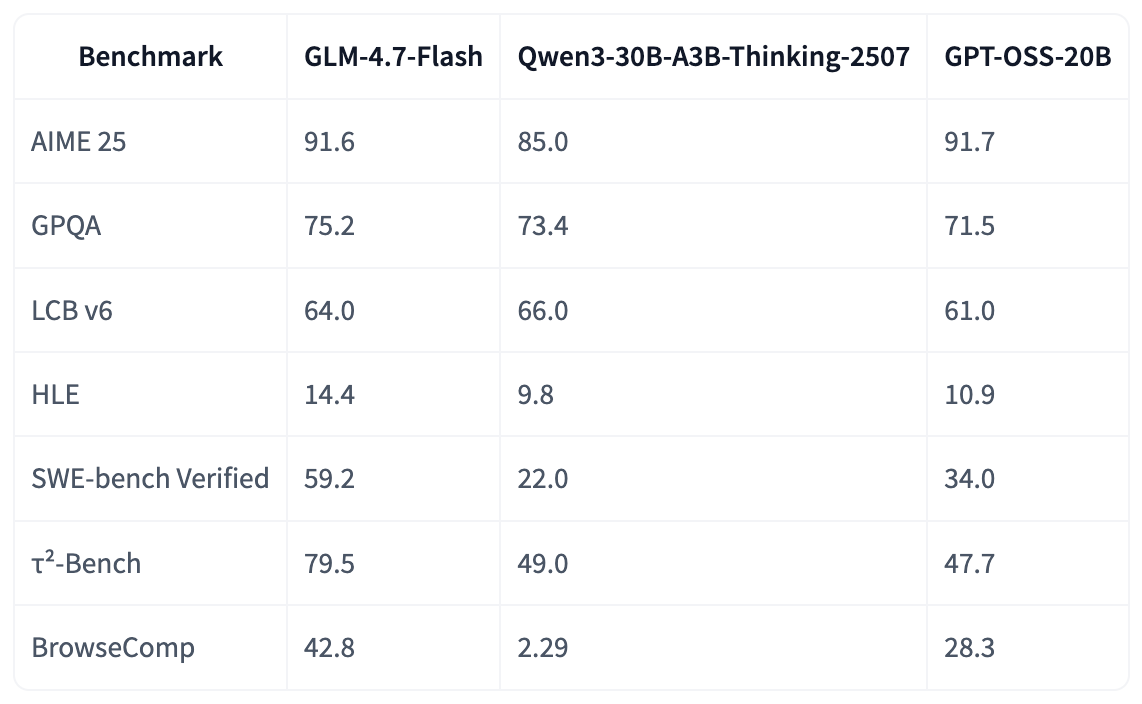

在SWE-bench Verified和τ²-Bench等流行基准测试中,GLM-4.7-Flash超越了gpt-oss-20b和Qwen3-30B-A3B-Thinking-2507,在同规模或类似规模模型系列中取得了开源SOTA(最先进)分数。

在内部编程测试中,GLM-4.7-Flash在前端和后端任务中均表现出色。除了编码场景,智谱还推荐用户体验该模型在中文写作、翻译、长上下文以及情感或角色扮演任务等通用用例中的表现。

对于本地部署,GLM-4.7-Flash支持包括vLLM和SGLang在内的推理框架。详细的部署指南可在官方Github仓库获取,vLLM和SGLang仅在其主分支上支持GLM-4.7-Flash。

来源:智谱

相关新闻

国产大模型近期升级综述:长周期 Agent、代码智能体与统一模型入口成为新焦点

2026年5月30日

DeepSeek V4 上线 API:国产模型进入更强推理与兼容生态阶段

2026年5月30日

文心 5.1 发布:国产大模型进入高效能智能体阶段

2026年5月30日