新闻资讯

2025年12月16日

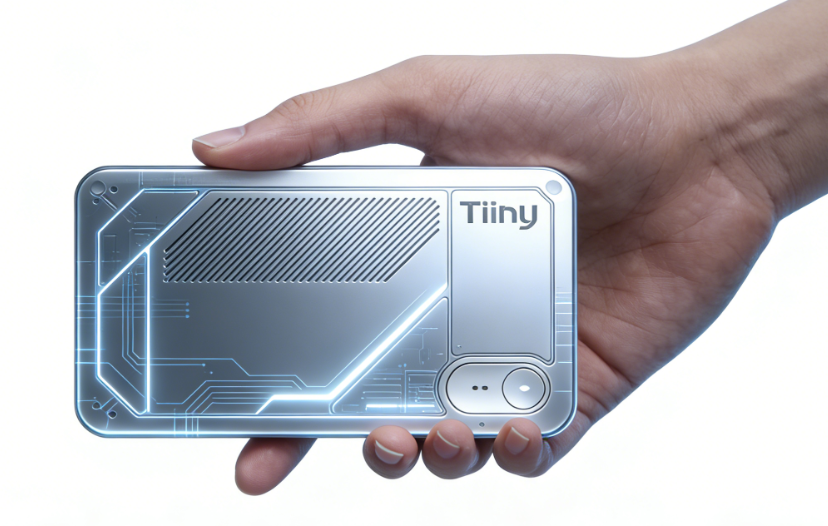

全球最小 AI 超级计算机横空出世:Tiiny AI Pocket Lab 如何颠覆 AI 使用场景?

全球最小的AI超级计算机Tiiny AI Pocket Lab,仅手掌大小却能运行1200亿参数模型,挑战传统计算边界。它让服务器级算力触手可及,通过TurboSparse和PowerInfer技术实现高效本地推理,摆脱云计算束缚,将智能真正交还用户手中。

# 全球最小AI超级计算机横空出世:Tiiny AI Pocket Lab如何颠覆AI使用场景? 在AI技术飞速迭代的当下,超级计算机曾一直被“庞大体积”和“高昂成本”两大标签束缚,仅限少数科研机构或科技巨头使用。但2025年末,Tiiny AI推出的一款“口袋级”设备,彻底打破了这一固有认知——经金氏世界纪录认证的Tiiny AI Pocket Lab,以移动电源般的尺寸,实现了传统大型设备难以企及的运算能力,为AI技术的“平民化”与“本地化”翻开了新篇章。 从外观来看,Tiiny AI Pocket Lab完全颠覆了人们对超级计算机的想象。它的机身尺寸仅为14.2×8×2.53厘米,重量控制在300克以内,单手即可轻松握持,放进背包、口袋毫无压力,彻底摆脱了传统超级计算机“机房级”的占地需求。但“小身材”里藏着“大能量”:设备搭载最新ARM v9.2 12核CPU,内置能提供190 TOPS运算能力的神经处理器(NPU),配合80GB LPDDR5X高速内存与1TB固态硬盘,不仅能流畅运行GPT-OSS、Llama、Qwen等主流开源AI模型,更可支持参数规模高达1200亿的大型模型,将“服务器级算力”真正装进了口袋。 相较于市场上同类小型计算设备,Tiiny AI Pocket Lab的核心优势不仅在于“小”,更在于对“AI使用痛点”的精准破解。此前,NVIDIA推出的Project Digits、DGX Spark等产品虽也主打“小型化”,但价格门槛较高,普通研究者或爱好者难以触及;而传统AI应用又高度依赖云计算,既受限于网络稳定性,又存在数据隐私泄露的风险。Tiiny AI的GTM总监Samar Bhoj直言:“当前AI的瓶颈从不是运算能力,而是对云计算的过度依赖。智能不该只存在于遥远的数据中心,而应属于每一个人的日常。” 为实现“本地化高算力”的目标,Tiiny AI为Pocket Lab集成了两项独家核心技术。其中,TurboSparse采用神经元级稀疏启动方法,能在不损失模型智能度的前提下,大幅提升推理效率,让大型模型在本地运行时更流畅;PowerInfer异构推理引擎则可智能分配AI工作负载,将复杂运算交给NPU、基础任务交给CPU,在实现“服务器级性能”的同时,把设备典型功耗控制在约65瓦特(CPU TDP约30瓦),配合内置主动散热系统,即便长时间运行大型模型,也能保持稳定状态。 这款设备的出现,无疑将重塑多个领域的AI应用场景。对于科研人员而言,无需再争抢实验室的大型计算资源,只需一台Pocket Lab,就能随时随地开展模型训练、算法验证;AI爱好者可基于设备自由调试开源模型,探索个性化应用;即便是普通用户,也能在本地运行大参数AI模型,处理文档分析、图像生成等需求,且不必担心数据上传云端的隐私安全。 从行业前景来看,Tiiny AI Pocket Lab的布局精准契合了AI市场的发展趋势。根据Grand View Research数据,2025年全球大型语言模型市场估值已达74亿美元,预计到2030年将飙升至354亿美元,而“个性化AI”“本地智能”正是未来市场的核心增长点。目前,Tiiny AI计划在2026年CES展会上对Pocket Lab进行实地展示,尽管价格与发售细节尚未公布,但业界已普遍期待——这款“最小AI超级计算机”能进一步降低先进AI技术的使用门槛,推动更多行业进入“本地高算力”时代。 当AI设备从“机房”走向“口袋”,从“云端依赖”转向“本地自主”,Tiiny AI Pocket Lab不仅是一次硬件创新,更预示着“人人可享智能”的未来已近在眼前。

相关新闻

AI疗愈最新方向研究报告(2024-2026)

2026年4月10日

Qwen3.6-Plus 发布:面向企业级 Agent 场景升级

2026年4月8日

中国思政教育未来发展研究报告(2024-2026)

2026年4月8日